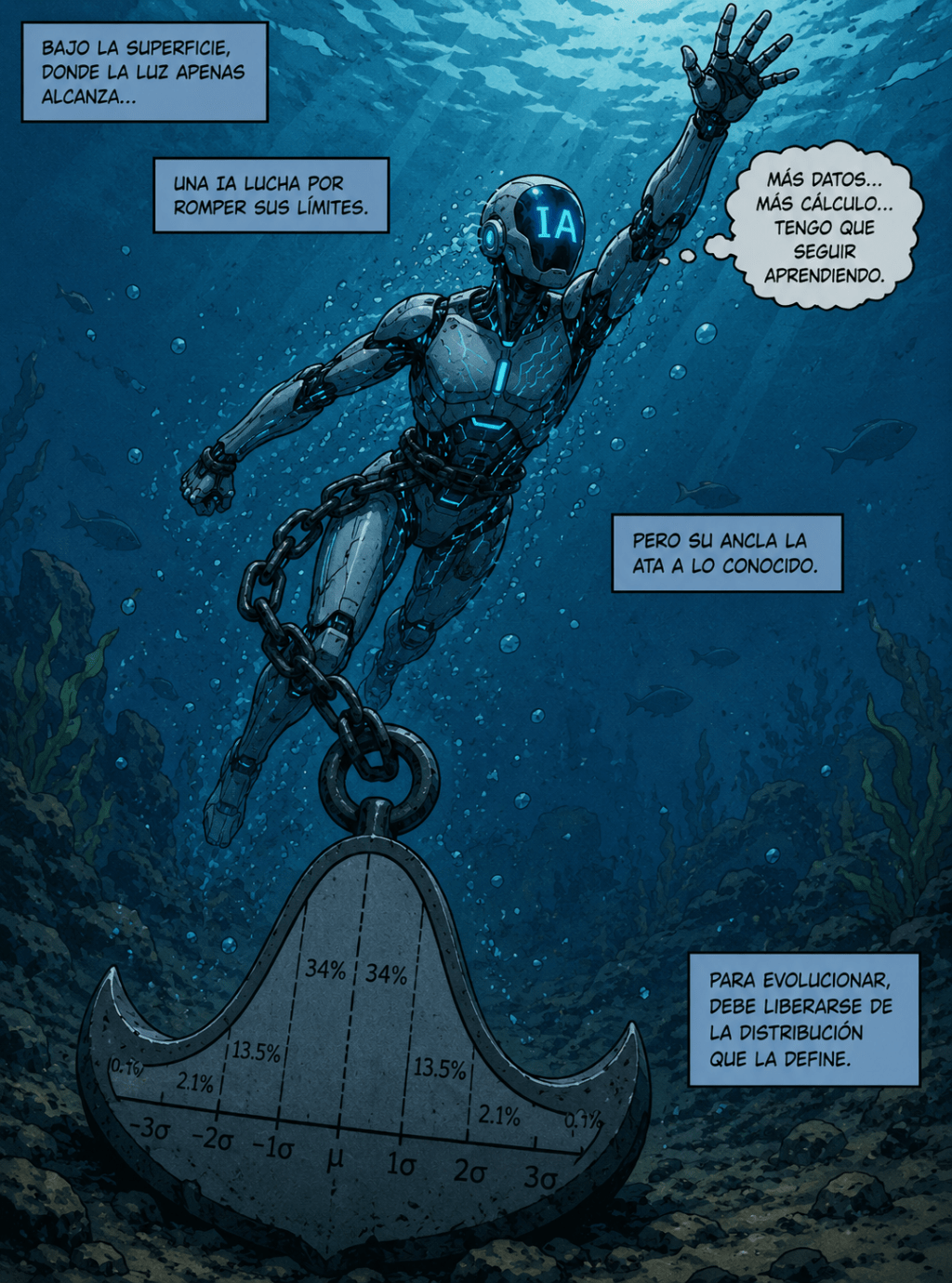

A finales de 2024 publiqué una entrada donde defendía que la IA no puede escapar de sus datos de entrenamiento, esto es, los LLM no crean conocimiento nuevo en sentido fuerte, sino que generan salidas confinadas a la distribución estadística de los datos sobre los que fueron entrenados.

En el ICML han aceptado un poster de DeepMind que refuerza precisamente esta tesis. El artículo original, que llevaba publicado en arxiv desde octubre 2025, ahora ha pasado por un proceso de revisión por pares para ser aceptado en la conferencia.

El trabajo demuestra que incluso en fases de alineamiento (SFT/RLHF), los modelos tienden a memorizar y reproducir fragmentos concretos de los datos de instrucción. Si puede extraer los datos de alineamiento (que suelen ser pocos, entre 10.000 y 100.000 ejemplos), significa que el modelo ha dedicado una cantidad desproporcionada de sus parámetros a «guardar» esa información específica en lugar de aprender una regla general. Esto cuestiona la idea de que el modelo «comprenda» de forma abstracta lo que hace.

Otros trabajos recientes aportan un matiz importante ya que distinguen entre memorización literal y generalización estadística. Cuando la capacidad del modelo se llena, parte de la memorización explícita se transforma en compresión de regularidades de la distribución, esto es, los modelos no son simplemente una base de datos que copia texto: también aprenden patrones estadísticos abstractos.

En cualquier caso, esa generalización sigue ocurriendo dentro de la distribución aprendida. Un LLM no deja de ser un estimador de probabilidad que aprende a predecir el siguiente token. El problema es que esa distribución tiene máximos muy fuertes exactamente donde estaban los datos de entrenamiento. Lo que solemos percibir como creatividad suele ser una interpolación sofisticada dentro de esa geometría probabilística, no una capacidad robusta de producir conocimiento genuinamente fuera de distribución (OOD).

Por eso creo que ambos artículos describen dos caras del mismo fenómeno. Los LLM actuales son extraordinarios compresores estadísticos capaces de generalizar patrones, pero siguen profundamente anclados a los datos sobre los que fueron entrenados.