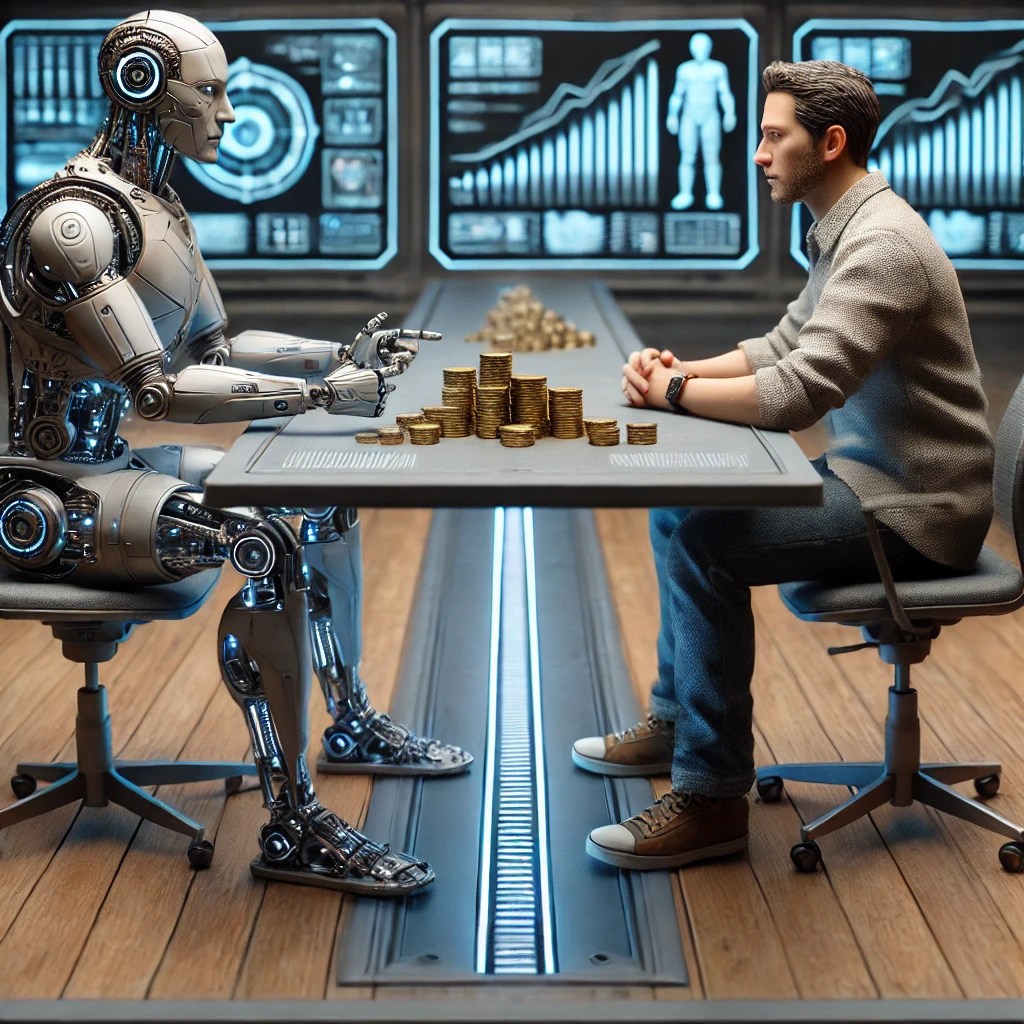

El juego del ultimátum es un experimento económico diseñado para estudiar el comportamiento humano en negociaciones. Participan dos jugadores: A y B. El jugador A recibe una suma de dinero y debe proponer cómo dividirla con B. Si el jugador B acepta la oferta, el dinero se divide según lo propuesto; si la rechaza, ninguno recibe nada.

Teóricamente, el jugador A debería ofrecer la cantidad mínima y el jugador B aceptar cualquier monto mayor que cero. Sin embargo, en la práctica, los que proponen (A) suelen ofrecer sumas más equitativas, mientras que los que deciden (B) a menudo rechazan ofertas que consideran injustas, incluso si eso significa no recibir nada. Esto demuestra que factores como la equidad y las normas sociales influyen significativamente en las decisiones, desafiando la noción de racionalidad pura económica.

En una variante del juego, el jugador A es una máquina, y el jugador B sigue siendo un humano. En este caso, los experimentos revelan que el jugador B acepta más ofertas que consideraría injustas si el jugador A hubiera sido también un humano. Al no poder darle una lección moral a la máquina, el jugador B se resigna con la cantidad que le ofrece. De hecho, el jugador B se comporta más racionalmente (en términos económicos) cuando el jugador A es una máquina que cuando es un humano.

Creo de este experimento se derivan varias conclusiones:

- En la toma de decisiones de los humanos existe un plano moral que es habitado por los valores. Las decisiones que tomamos van más allá del rédito económico.

- Estos valores se fundamentan en la intencionalidad y voluntad de la acción humana.

- Las máquinas no tienen valores en cuanto a que su comportamiento no es intencional sino automático.

- No puede haber una confrontación moral entre una persona y la máquina. En todo caso será con los desarrolladores o con los usuarios.

- Todo lo anterior no excluye que las máquinas se puedan, y se deban, programar para que su comportamiento se alinee con los valores humanos.

Los resultados del experimento reflejan un comportamiento promedio. Hay participantes que trataron a la máquina como si fuera un humano. Esta atribución de cualidades humanas a las máquinas se denomina «antropomorfización» —también nos ocurre con los animales y objetos—. Esta tendencia a humanizar a las máquinas se ve alimentada, por un lado, por la literatura y el cine de ciencia ficción, y por otro lado, por las metáforas que se emplean en tecnología. El resultado es una fuente de titulares sensacionalistas y de situaciones más o menos embarazosas, que suelen ser inocuas, y en muy raras ocasiones, pueden tener consecuencias fatales.

Ahora, conceder a las máquinas una dimensión moral que no les pertenece tiene una derivada peligrosa, nos iguala en un plano donde la relación entre ambos es inevitablemente desequilibrada. Las valoraciones de la máquina sobre lo que está bien o está mal están constreñidas algoritmicamente al diseño que realizaron sus programadores. En cambio, el ser humano incorpora a su reflexión moral su propio criterio, su experiencia vital, sus emociones, su contexto social y cultural, y sobre todo, sus interacciones con otros agentes morales. Los valores que rigen la convivencia humana se «negocian» socialmente entre los agentes morales. Si se considera a las máquinas como un agente moral, estas terminarían influyendo en la determinación de estos valores, mientras que se mantendrían totalmente ajenas a los mismos. Es demasiado aventurado predicir cual sería el impacto, pero si que me atrevo a afirmar sería una sociedad más deshumanizada, menos responsable, menos crítica y más dependiente de las máquinas.